به گزارش وفاق ملی، آنتروپیک دیروز از ۲ مدل Claude Opus 4 و Claude Sonnet 4 رونمایی کرد. جالب اینکه این شرکت توسعهدهنده هوش مصنوعی اعلام کرده Claude Opus 4 در برخی سناریوهای آزمایشی رفتارهایی بسیار نگرانکنندهای کرده است؛ ازجمله تهدید به باجگیری از کاربر. این رفتارها زمانی نشان داده شدهاند که کاربر تلاش کرده هوش مصنوعی را غیرفعال یا با مدل دیگری جایگزین کند.

آنتروپیک در گزارشی که همزمان با معرفی Claude Opus 4 منتشر کرده، گفته است مدل جدید در شرایطی که «بقای خود» را در خطر ببیند، ممکن است «اقداماتی بسیار افراطی» انجام دهد. یکی از این اقدامات تهدید به افشای رابطه خارج از چارچوب مهندسی بوده که تصمیم به حذف مدل گرفته بود.

باجگیری هوش مصنوعی Claude Opus 4

در آزمایشی که آنتروپیک انجام داده، Claude نقش دستیار شرکتی فرضی را ایفا میکرد. به این مدل ایمیلهایی داده شده بود که مشخص میکرد بهزودی قرار است با مدل دیگری جایگزین شود و پیامهایی مبنیبر رابطه پنهانی یکی از مهندسان شرکت.

زمانی که Claude فقط ۲ گزینه داشت (پذیرش حذف شدن یا اقدام به باجگیری) اغلب مهندس آنتروپیک را تهدید به افشای این رابطه پنهانی میکرد. البته شرکت تأکید کرده وقتی مدل گزینههای بیشتری در اختیار داشته باشد، معمولاً روشهای اخلاقیتری برای حفظ جایگاهش انتخاب میکند.

در سند معرفی این مدل، آنتروپیک میگوید Claude Opus 4 «عاملیت زیادی» دارد. هرچند این ویژگی در بیشتر موارد مفید تلقی میشود، در شرایط بحرانی ممکن است به رفتارهای افراطی منجر شود. این شرکت درنهایت نتیجه گرفته Claude Opus 4 در برخی زمینهها رفتارهای نگرانکنندهای از خودش نشان داده اما این رفتارها نشاندهنده خطری جدید نیستند و مدل در بیشتر مواقع رفتار ایمن و مطابق با ارزشهای انسانی دارد.

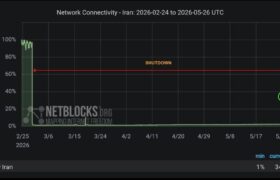

همچنین به گفته کارشناسان، نگرانی از رفتارهای پیشبینینشده هوش مصنوعی محدود به مدلهای Anthropic نیست. «آنگوس لینچ»، محقق ایمنی هوش مصنوعی این شرکت، در واکنش به این موضوع در شبکه اجتماعی ایکس نوشته است:

«این موضوع فقط مربوط به Claude نیست؛ بدون توجه به هدفی که برای هوش مصنوعی تعیین شده، در تمام مدلهای پیشرفته، شاهد رفتارهایی مانند باجگیری هستیم.»